温室番茄生产具有典型的劳动密集特征,采摘工作量和工作强度尤其突出,机器换人需求强烈且迫切。采摘机器人的高效作业要求高精度和高稳定性的视觉识别,然而,温室内受光照条件不稳定和作物结构性遮挡等影响,视觉识别经常遇到亮度降低、对比度下降及细节丢失等图像质量退化问题成为制约智能采摘作业的关键技术瓶颈。现有图像增强方法难以在复杂场景下兼顾全局光照恢复与局部细节保持,而深度学习计算成本高且难以满足采摘机器人的实时性要求。

近日,信息所智慧农业创新团队在采摘机器人低照度与遮挡作业场景下的图像增强技术创新方面取得重要进展。相关研究以“A global-local collaborative image enhancement method for low-illumination and occluded scenes in robotic tomato picking”为题发表于《Computers and Electronics in Agriculture》(IF 8.9,中科院一区Top期刊,非OA)。该论文提出了一种全局-局部协同图像增强方法(Global-local collaborative image enhancement method),能够提升复杂环境下番茄图像的视觉感知质量及下游任务精度。

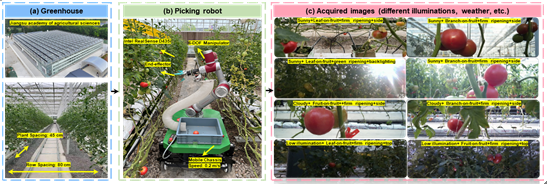

研究首先构建了面向真实温室环境的番茄图像数据集,通过自主研发的采摘机器人在不同天气、光照方向及遮挡类型下采集了3000张典型图像,确保了数据的多样性与可靠性,为算法验证奠定了扎实基础。

图1 真实温室环境下数据采集与典型退化场景示例

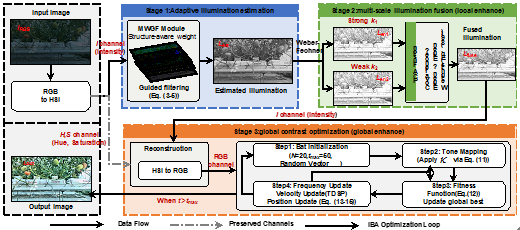

针对低照度与结构性遮挡并存的复合退化挑战,研究有三个关键创新点:(1)设计了自适应光照估计算法,利用多尺度加权引导滤波提取结构感知光照先验,有效抑制了暗区域噪声;(2)提出了多尺度光照融合机制,结合主成分分析与韦伯-费希纳感知模型,在增强局部细节的同时最小化颜色失真与伪影;(3)构建了全局对比度优化策略,采用改进的蝙蝠算法动态寻优对比度系数,实现了图像可视性与结构保真度的最佳平衡。

图2 全局-局部协同图像增强方法框架图

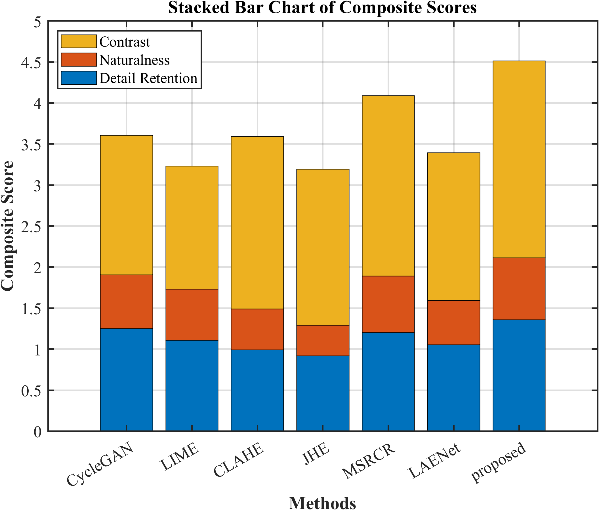

研究结果表明,该方法在信息熵(Entropy)、结构相似性(SSIM)及自然图像质量评价(NIQE)等指标上均优于CLAHE、MSRCR、CycleGAN等主流基线方法。在下游视觉任务验证中,增强后的图像使目标检测平均精度提升了2.6%,其中小目标检测精度提升了3.8%;语义分割平均交并比提升了3.6%,改善了严重遮挡下的果实边界分割效果。此外,该方法在标准CPU上的平均推理时间仅为47.9毫秒,具备优异的实时性。该研究为设施环境下采摘机器人的全天候精准作业提供了重要的视觉增强技术支撑。

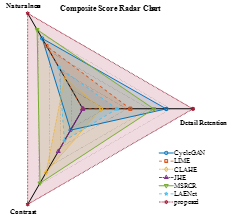

(a) (b)

图3 不同增强方法性能的综合分析,(a)不同方法的雷达图,(b)不同方法的堆积条形图。

信息所智慧农业创新团队青年骨干曹毅博士为论文第一作者,团队首席任妮研究员为通讯作者。该研究得到江苏省重点研发计划项目(BE2021379)、江苏省农业科技自主创新资金项目(CX(24)1021)的资助。